该软件具备强大的驱动自动管理功能,彻底解决了用户手动下载安装驱动程序的繁琐难题,通过智能识别硬件需求,系统能自动检测、更新并修复驱动程序,确保设备始终处于最佳运行状态,让电脑维护变得简单高效,极大提升了使用体验。

Windows下Python爬虫环境配置全攻略

对于许多初学者来说,Python 是进行网络爬虫开发的首选语言,在 Windows 系统下配置一个稳定、高效的爬虫环境,往往比在 Linux 或 macOS 上要复杂一些,由于 Windows 系统的兼容性问题和版本管理差异,新手很容易在安装依赖包或配置浏览器驱动时遇到阻碍。

本文将手把手教你如何在 Windows 系统上搭建一套标准的 Python 爬虫环境,助你避开“坑点”,快速起飞。

基础准备:安装 Python 与 Git

在开始之前,请确保你的电脑上已经安装了必要的工具。

-

安装 Python

- 访问 Python 官网 下载最新版本的安装包。

- 关键步骤: 在安装界面,务必勾选 “Add Python to PATH”(将 Python 添加到环境变量),这一步能让你在命令行直接调用 Python,避免后续频繁配置环境变量的麻烦。

- 安装完成后,在 CMD 中输入

python --version验证是否安装成功。

-

安装 Git(可选)

如果后续需要从 GitHub 克隆项目代码,建议安装 Git 并配置好环境变量。

项目隔离:创建虚拟环境

为了避免不同项目之间的依赖包冲突,强烈建议为每个爬虫项目创建一个独立的虚拟环境。

- 在你的工作目录下(

D:\Projects\Spider),打开 CMD 或 PowerShell。 - 执行以下命令创建虚拟环境:

python -m venv venv

(

venv是虚拟环境的名称,你可以自定义)。 - 激活虚拟环境:

- CMD (命令提示符):

venv\Scripts\activate - PowerShell:

venv\Scripts\Activate.ps1 - 激活成功后,你的命令行前面会出现

(venv)的提示符。

- CMD (命令提示符):

核心依赖:安装常用库

在激活虚拟环境的状态下,使用 pip 安装爬虫开发中最常用的库。

-

HTTP 请求库:

pip install requests

requests是 Python 爬虫的基石,用于发送网络请求。 -

HTML 解析库:

pip install beautifulsoup4 lxml

BeautifulSoup用于解析 HTML 文档,提取数据;lxml是一个更高效的解析器。 -

数据存储库:

pip install pandas

如果你的爬虫需要处理大量数据,Pandas 是处理表格数据的神器。

-

自动化测试库:

pip install selenium

当目标网站有反爬机制(如验证码、动态加载)时,Selenium 是必不可少的工具。

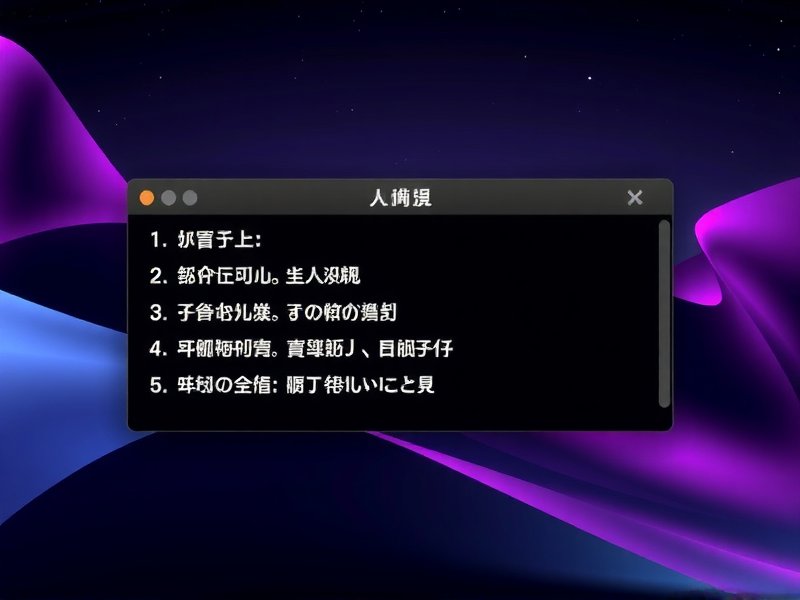

难点攻克:配置浏览器驱动

使用 Selenium 进行爬虫开发时,最大的痛点在于 ChromeDriver 的版本匹配问题。

- 问题: 你的浏览器版本可能更新了,但 ChromeDriver 还是旧的,导致报错。

- 解决方案(推荐): 使用

webdriver-manager库,它会自动检测你的浏览器版本并下载匹配的驱动。

在虚拟环境中安装并配置:

pip install webdriver-manager

示例代码:

from selenium import webdriver

from selenium.webdriver.chrome.service import Service

from webdriver_manager.chrome import ChromeDriverManager

driver = webdriver.Chrome(service=Service(ChromeDriverManager().install()))

driver.get("https://www.google.com")

print(driver.title)

进阶技巧:代理设置

在 Windows 上配置爬虫环境,通常还需要考虑到 IP 代理的问题。

-

在代码中设置代理: 使用

requests库时,可以在proxies参数中设置 HTTP 代理。import requests proxies = { 'http': 'http://127.0.0.1:7890', 'https': 'https://127.0.0.1:7890', } response = requests.get('http://